因为深度神经网络在悬链的过程中总会遇到两大缺点:1.容易过拟合 2.耗时。Dropout的出现其实就是为了解决,以上两点问题。那么什么是Dropout呢?

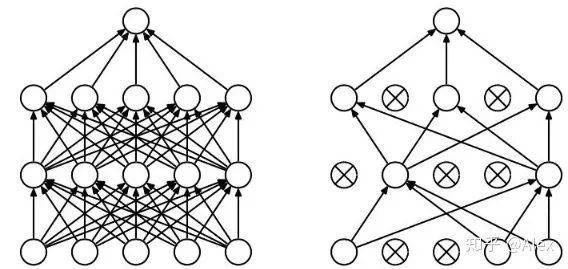

Drop out顾名思义,就是丢弃的意思,对于神经网络来说就是丢弃一些神经元,丢弃?不,这里指的是让这些神经元失效或者状态抑制。一个简单的Drop out的示意图如下所示:

在训练阶段,以概率p主动临时性地忽略掉部分隐藏节点。这一操作的好处在于,在较大程度上减小了网络的大小(解决了耗时的问题),而且多个这样的抑制不同隐藏神经元的网络组合可以解决过拟合问题。

在预测阶段,将参与学习的节点和那些被隐藏的节点以一定的概率p加权求和,综合计算得到网络的输出。对于这样的类似融合不同模型的学习过程,有学者认为,Drop out可视为一种集成学习(Ensemble Learning)。

参考文献:

blog.csdn.net/qq_196727

blog.csdn.net/yhily2008

blog.csdn.net/dQCFKyQDX

文章转载自百面机器学习,如果涉嫌侵权,请发送邮件至:contact@modb.pro进行举报,并提供相关证据,一经查实,墨天轮将立刻删除相关内容。